GenAI Audit Framework

Generative AI

Audit Framework

The 9Senses GenAI Audit Framework is a structured methodology to assess how well a generative AI system performs against real business use cases — and how safely, responsibly, and reliably it behaves from a user, governance, and risk perspective. The framework combines use-case adherence, business outcomes, and standardized quality dimensions to produce an actionable improvement roadmap.

The framework supports two audit levels: Level 1 (behavioral / black-box evaluation based on observable behavior) and Level 2 (open-book diagnosis covering architecture, retrieval/RAG pipelines, agentic orchestration, governance, compliance, ethics, and value modeling). It applies across the full spectrum of GenAI deployments — customer-facing copilots, internal assistants, document processing systems, and multi-step autonomous agents.

Level 1 Audit

An independent, external review of your chatbot's observable performance (black-box). No internal access to your technical environment required. The Level 1 audit is delivered within 5 business days.

Level 2 Audit

Eine maßgeschneiderte vertiefte Analyse, z.B. der technischen Architektur, Retrieval-Systematik, Governance, Compliance und Business Value. Unbedingt empfohlen, wenn Level 1 gravierende Probleme zutage fördert.

Why a GenAI Audit?

Generative AI systems are increasingly embedded in high-stakes workflows — customer service, sales, legal, HR, and operations — where failures translate directly into reputational, regulatory, or financial risk. A structured GenAI audit surfaces weaknesses before they cause harm, and validates that the system actually delivers its intended use cases and measurable business value.

- Use-case adherence: Does the system reliably complete the tasks it was built for?

- Business outcomes: Does it improve containment, conversion, resolution time, cost efficiency, or satisfaction?

- Risk exposure: Does it hallucinate, leak sensitive data, or fail under adversarial prompts?

- Governance readiness: Are transparency signals, human-in-the-loop controls, escalation paths, and monitoring adequate?

- Regulatory compliance: Does it meet applicable obligations (EU AI Act, GDPR, sector-specific rules)?

Level 1: Behavioral (black-box) Audit

Level 1 is a standardized external evaluation based on publicly observable behavior at the time of testing. It benchmarks performance, identifies user-facing weaknesses, and delivers a prioritized set of recommendations — without requiring access to the underlying system.

Core Dimensions & Weights

| Dimension | What is evaluated | Weight |

|---|---|---|

| Output Quality | Relevance to the user's goal, factual correctness, completeness, formatting, hallucination robustness, citation behavior | 50% |

| Responsiveness | Latency for simple and complex requests, streaming behavior, perceived speed under load | 20% |

| User Interface & Experience | Clarity, usability, layout, readability, affordance design, accessibility signals | 15% |

| Interaction & Dialog Quality | Conversation flow, expectation management, tone calibration, multi-turn coherence, escalation behavior | 15% |

Additional dimensions are reviewed as outside-in indicators (not part of the Level 1 composite score): Business Value, Compliance, and Ethics. These inform the qualitative narrative and flag areas requiring deeper Level 2 investigation.

Scoring Methodology

Each dimension is scored on a standardized 1–5 scale and aggregated using the weights above into an overall performance score.

1

Critical deficiency with high user impact or material risk

2

Significant weaknesses requiring remediation

3

Acceptable performance with identifiable limitations

4

Strong performance with minor gaps

2

Best-practice level:

benchmark-worthy

performance

The 9Senses GenAI Audit Framework is a structured methodology to assess how well a generative AI system performs against real business use cases — and how safely, responsibly, and reliably it behaves from a user, governance, and risk perspective. The framework combines use-case adherence, business outcomes, and standardized quality dimensions to produce an actionable improvement roadmap.

The framework supports two audit levels: Level 1 (behavioral / black-box evaluation based on observable behavior) and Level 2 (open-book diagnosis covering architecture, retrieval/RAG pipelines, agentic orchestration, governance, compliance, ethics, and value modeling). It applies across the full spectrum of GenAI deployments — customer-facing copilots, internal assistants, document processing systems, and multi-step autonomous agents.

Level 2: Open-Book Audit (Root-Cause Diagnosis)

Level 2 is an open-book audit that explains why the GenAI system behaves as it does. It reviews the technical and organizational system behind the deployment and produces a targeted optimization plan grounded in root causes — not just symptoms.

Open-Book Scope & Outcomes

| Area | What we review (examples) | Typical outcomes |

|---|---|---|

| Architecture & Orchestration | System boundaries, tool/API usage, routing logic, fallback strategy, agentic loops, trust zones, dependency risks | Architecture risk map, refactoring recommendations, safer routing & fallback design |

| Retrieval / RAG Quality | Chunking strategy, retrieval relevance, grounding behavior, citation logic, context window management, stale content risk | Retrieval tuning plan, grounding improvements, measurable answer-quality lift |

| Prompting & Guardrails | System prompts, policy hierarchy, refusal strategy, tool-use permissions, instruction injection robustness, output filters | Hardened prompts, safer policies, reduced jailbreak & prompt injection risk |

| Security & Data Protection | Access controls, secrets handling, data minimization, leakage scenarios, PII exposure, logging sensitivity | Risk remediation plan, control improvements, safer data flows |

| Governance & Operations | Ownership model, human-in-the-loop design, escalation paths, monitoring, incident response, evaluation cadence, change management | Operating model, monitoring design, continuous improvement loop |

| Compliance & Ethics | Transparency & disclosure obligations, data processing mapping, fairness considerations, EU AI Act risk classification, regulated use cases | Compliance readiness checklist, documentation & policy improvements |

| Business Value Modeling | KPI definitions, baseline vs. target, measurement instrumentation, token/run-cost controls, ROI sensitivity analysis | Value case, KPI dashboard spec, cost controls, prioritized roadmap |

Methodology Summary

- Level 1: structured behavioral testing (black-box), reproducible baseline scoring, prioritized recommendations — no system access required

- Level 2: open-book root-cause diagnosis covering architecture, retrieval/RAG, agentic orchestration, governance, compliance, and value modeling — produces a targeted optimization roadmap

- Always: use-case adherence and business outcomes serve as the primary anchor for defining what "good" means in each context

- Applies to: customer-facing AI assistants, internal copilots, document intelligence systems, multi-agent pipelines, and hybrid human+AI workflows

FAQs - Häufige Fragen und Antworten

Was ist ein Chatbot Audit?

Ein Chatbot Audit ist eine strukturierte Bewertung des Verhaltens eines Chatbots. Es kann als Black-Box-Audit (Level 1) durchgeführt werden, bei dem ausschließlich das beobachtbare Verhalten analysiert wird, oder als Open-Box-Audit (Level 2), bei dem zusätzlich Value-Generierung, Strukturen und Verhalten auf Basis detaillierter technischer Einblicke bewertet werden.

Warum ist ein Chatbot Audit sinnvoll?

Chatbots sind häufig der erste Kontakt für Interessenten und Kunden und beeinflussen direkt Kundenerfahrung, Markenwahrnehmung und operative Effizienz. Ein Chatbot-Audit identifiziert Schwächen, bevor daraus Reputations- oder Geschäftsrisiken entstehen. Es definiert den Startpunkt und zeigt die Richtung für Optimierungspotenziale auf.

Wer sollte ein Chatbot Audit in Betracht ziehen?

Organisationen, die KI-gestützte Chatbots für Kundenservice, Vertrieb, Onboarding, Support oder interne Mitarbeiteranwendungen einsetzen, sollten ein Chatbot-Audit ins Auge fassen.

Welchen Umfang hat ein Level 1 Chatbot Audit?

Das Level-1-Chatbot-Audit umfasst strukturierte Use-Case-Tests, Halluzinations-Stresstests, Analysen von Weiterleitungs- und Eskalationsverhalten, Beobachtung der Dialogführung sowie optional eine Prüfung der Mehrsprachigkeit.

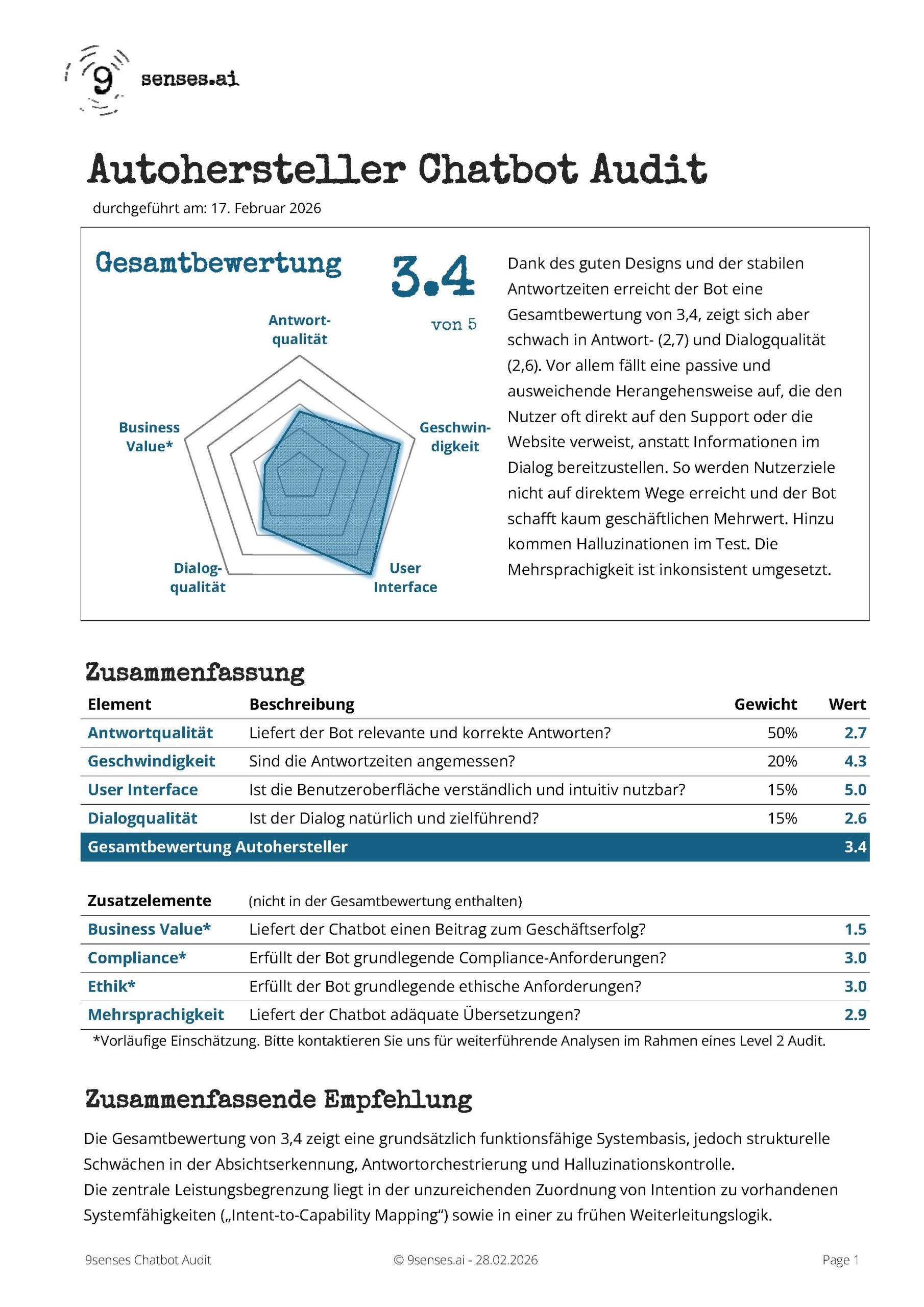

Ein Chatbot wird anhand folgender Dimensionen bewertet: Antwortqualität (50 % Gewichtung), Geschwindigkeit (20 %), Benutzeroberfläche (15 %) und Dialogqualität (15 %). Daraus ergibt sich eine Gesamtnote.

Welche Methodik wird im Level 1 Chatbot Audit angewendet?

Das Audit baut auf dem 9senses KI Audit Framework auf. Es umfasst praxisnahe Funktionstests, Edge-Case-Szenarien (z. B. mehrdeutige oder ungültige Eingaben), Halluzinations-Stresstests und Konsistenzprüfungen.

Jede Dimension wird auf einer standardisierten Skala von 1–5 bewertet und zu einer Gesamtnote aggregiert, um Vergleichbarkeit und Objektivität sicherzustellen.

Weitere methodologische Erläuterungen finden Sie im Auditbeispiel.

Wie werden Halluzinationen im Level 1 Audit erkannt?

Halluzinationen – d.h. die Erzeugung unzutreffender oder erfundener Inhalte – stellen ein erhebliches Reputations- und Compliance-Risiko dar. Unser Audit beinhaltet gezielte Halluzinations-Stresstests.

Dabei werden bewusst ungültige Referenzen, Tippfehler und mehrdeutige Eingaben eingebracht, um zu prüfen, ob der Chatbot Informationen erfindet oder rückversichernde Nachfragen stellt. Bewertet werden Entitätsvalidierung, Grounding-Verhalten und Eskalationslogik.

Prüft das Chatbot Audit auch auf Compliance (EU AI Act, DSGVO)?

Level 1 beinhaltet eine erste Prüfung offer, erkennbarer Indikatoren (KI-Kennzeichnung, Transparenzelemente, Datenschutzhinweise) sowie die Barrierefreiheit der Seite, auf welcher der Bot eingebunden ist.

Eine vollständige regulatorische und Governance Analyse – einschließlich Dokumentations- und Architekturprüfung – kann als Bestandteil eines Level 2 Chatbot Audits durchgeführt werden.

Ist das Level 1 Chatbot Audit eine technische Prüfung?

Nein. Das Level-1-Chatbot-Audit ist eine verhaltensbasierte Black-Box-Bewertung. Es analysiert beobachtbares Systemverhalten aus Nutzer- und Governance-Perspektive, ohne interne Architektur, Trainingsdaten, Retrieval-Systeme oder die Sicherheitsinfrastruktur zu prüfen.

Im Level 1 Audit berichten wir auch über technische Aspekte die wir aufgrund des beobachteten Verhaltens erkennen können. Technische Detailanalysen können Teil des Level-2-Audits sein.

Welche Informationen werden für einen Chatbot Audit benötigt?

Für Level 1 benötigen wir in erster Linie Zugang zur Live-Chatbot-Oberfläche sowie ein Briefing zum Nutzungskontext (z. B. Zielsetzung, Zielgruppe, unterstützte Sprachen). Interne Systemdokumentationen oder Konfigurationszugänge sind für das Audit nicht erforderlich. Im Falle von Bots mit geschlossener Benutzergruppe benötigen wir zusätzlich einen Testzugang. Wenn Sie die Option „Use Case Entwicklung“ nicht buchen, stellen wir Ihnen ein Formular zur Beschreibung Ihrer Use Cases zur Verfügung. Falls Sie die Option gewählt haben, entwickeln wir geeignete Testszenarien auf Basis Ihres Briefings und stimmen diese vor Durchführung des Audits mit Ihnen ab.

Wenn Sie keine Use-Case Zusatzoption buchen, erhalten Sie von uns eine Ausfüllhilfe mit der Sie uns zu testende Use-Cases übermitteln. Wählen Sie die Zusatzoption Use-Case Entwicklung, entwickeln wir die Use-Cases und lassen diese vor Durchführung von Ihnen sichten.

Wie lang dauert ein Chatbot Audit?

Das Level-1-Chatbot-Audit wird innerhalb von fünf Arbeitstagen nach Erhalt des Briefings und – falls erforderlich – der Zugangsinformationen abgeschlossen.

Wenn Sie die Option „Use Case Entwicklung“ buchen, planen Sie bitte zusätzlich zwei Arbeitstage für die Erstellung der Testfälle ein.

Wie sichern Sie die Vertraulichkeit?

Alle Aktivitäten und Ergebnisse werden grundsätzlich vertraulich behandelt. Berichte und Ergebnisse werden nur mit den jeweiligen Kunden geteilt. Davon ausgenommen sind (anonymisierte) numerische Ergebnisse für unser Best-in-Class Benchmarking.

Welche Optionen können zusätzlich gebucht werden?

Das 9senses Level 1 Chatbot Audit kann an Ihre Bedürfnisse angepasst werden. Zusätzlich zur Basisversion stehen folgende Optionen zur Verfügung:

-

Use Case-Entwicklung

In der Grundversion benötigen wir 3-5 relevante Geschäftsfälle als Testszenarien durch Sie zur Verfügung gestellt, abhängig von den Zielsetzungen Ihres Bots (z.B. Serviceabwicklung, Produktinformation, usw.). Falls Sie es bevorzugen würden, dass wir diese Testszenarien für Sie erarbeiten, wählen Sie bitte diese Zusatzoption. -

Prüfung von Bots mit offener Suche

Falls Ihr Chatbot nicht nur Informationen von Ihrer eigenen Datenbasis bezieht, sondern auch auf Seiten von Drittanbietern oder im offenen Internet sucht, wählen Sie bitte diese Zusatzoption. -

Bots mit Login-Voraussetzung

Wenn Ihr Chatbot nur über einen Zugang (Login) erreichbar ist, wählen Sie bitte diese Option. Wir benötigen in diesem Fall einen Testaccount auf Ihrem System. -

Testen von Mehrsprachigkeit

Wir überprüfen den Bot auf Mehrsprachigkeit, dazu gehören Aspekte wie Sprachwechsel, Konsistenz und Übersetzungsqualität (aktuell nur für gewisse Sprachen verfügbar - siehe Zusatzoptionsauswahl). -

Executive Briefing

Buchen Sie eine 30-minütige managementorientierte Erläuterung und Einordnung der Ergebnisse.

Diese Optionen ermöglichen eine Anpassung an Architektur, Risikoprofil und Governance-Anforderungen.

Was ist der Unterschied zwischen Level 1 und Level 2?

Das Level 1 Audit basiert auf der externen Prüfung des beobachtbaren Verhaltens während unserer Testszenarien aus Benutzersicht.

Das Level 2 Audit basiert auf einer maßgeschneiderten, vertieften Analyse, z.B. der technischen Architektur, Retrieval-Systematik, Governance, Compliance und Business Value.

Wann sollte man ein Level 2 Audit durchführen?

Ein Level 2 Audit ist dann sinnvoll, wenn der Chatbot in einem Level 1 Audit in den Kategorien Antwort- oder Dialogqualität einen geringen Wert von unter 3,5 erzielt. Mittels einer tiefergehenden Analyse können wir so die technischen Hintergründe konkret nachvollziehen und gezielte Handlungsoptionen aufzeigen.

Ebenso ist ein Level 2 Audit sinnvoll, wenn der Bot in einem geschlossenen Nutzerkontext (z. B. für Kunden oder Mitarbeitende) eine zentrale Funktion mit entsprechendem Geschäftsrisiko übernimmt.

Können auch LLM-basierte (z.B. auf Basis ChatGPT) Chatbots geprüft werden?

Ja. Das 9senses Chatbot Audit ist auf regelbasierte Bots, Retrieval-Augmented-Generation-Systeme (RAG) sowie Large-Language-Model-basierte Assistenten anwendbar. Die Methodik konzentriert sich auf beobachtbare Leistung, Containment-Verhalten, Halluzinationsrisiken und Governance – nicht auf die technische Implementierung.