9senses über künstliche Intelligenz

Was ist KI überhaupt?

Als die meisten von uns bei 9senses begannen, sich mit Technologien zu befassen, die heute unter dem Begriff Künstliche Intelligenz laufen,,hat kaum jemand diesen Begriff verwendet. Wir sprachen damals unter anderem von nicht-linearer Programmierung, Fuzzy Logic, Heuristik und Machine Learning.

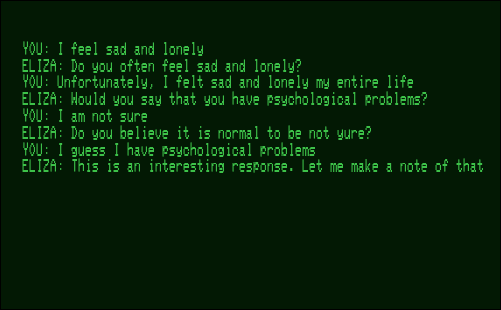

Heute glauben viele, dass Künstliche Intelligenz einen Computer befähigt, menschlich zu sein oder zu werden. In Tat und Wahrheit ist Computer-Software nach wie vor meilenweit davon entfernt, im Ganzen die Fähigkeiten eines Menschen zu erlangen. In bestimmten Bereichen kann KI allerdings menschliche Fähigkeiten hervorragend simulieren und in einigen Bereichen sogar übertreffen.Dies betrifft vor allem Fälle in denen große Datenmengen involviert sind. Auf dieser Seite möchten wir ein wenig Klarheit schaffen, was KI wirklich kann, auch wenn wir sie damit ein wenig entzaubern, so wie das Joseph Weizenbaum, der berühmte Erfinder von Eliza getan hat:

"Mir war nicht bewusst, wie sehr eine kurze Exposition gegenüber einem recht einfachen Computerprogramm bei ganz normalen Menschen starke Wahnvorstellungen auslösen kann."

Joseph Weizenbaum (1923-2008), Entwickler von Eliza

Aber was ist künstliche Intelligenz denn nun wirklich? Wir haben zwei KI-Sprachmodelle nach ihrer Definition von KI gefragt und haben zwei sehr unterschiedliche Antworten erhalten. Lesen Sie hier, was KI über KI zu sagen hat.

Nachdem sich nicht einmal verschiedene KI-Systeme darüber einig sind, was sie sind, haben wir keine Hemmungen, unsere eigene Antwort zu geben. Wir bei 9senses definieren KI als "ein Computersystem das in der Lage is, auf ein bisher noch nie erlebtes Ereignis sinnvoll zu reagieren, basierend auf der Analyse von Daten vieler ähnlicher Ereignisse in der Vergangenheit." Diese Fähigkeit unterscheidet KI deutlich von traditioneller Rechnerlogik, bei der jedes Ereignis (oder jede Kombination von Ereignissen) nur eine definierte Reaktion hat. Wir halten uns ausdrücklich davon fern, Computer mit Menschen zu vergleichen, weil diese selbst mit modernster KI noch Lichtjahre davon entfernt sind, unsere Fähigkeiten in Gänze zu erreichen. In einzelnen Bereichen wiederum sind sie uns weit überlegen.

ChatGPT answering “What is AI?”

Artificial Intelligence (AI) is the field of computer science focused on creating systems that can perform tasks that normally require human intelligence. AI enables machines to learn from experience, adapt to new inputs, and perform tasks like problem-solving, language understanding, perception, and decision-making.

AI can be broken down into several types and subfields:

- Narrow AI (or Weak AI) – AI systems designed for specific tasks, like voice recognition (e.g., Siri, Alexa), image recognition, or playing a game of chess. They excel at a narrow set of tasks but lack general awareness.

- General AI (or Strong AI) – Hypothetical AI that could perform any intellectual task a human can do, with the ability to reason, plan, and understand complex concepts. This level of AI does not yet exist.

- Machine Learning – A subset of AI that uses algorithms and statistical models to allow computers to learn from and make decisions based on data. For instance, machine learning is used in recommendation systems and predictive analytics.

- Deep Learning – A further subset of machine learning that uses artificial neural networks, inspired by the human brain, to analyze data and make decisions. Deep learning is commonly used in advanced image recognition, language processing, and autonomous driving.

- Natural Language Processing (NLP) – The branch of AI that focuses on enabling machines to understand, interpret, and respond to human language in a meaningful way.

AI is increasingly used in fields like healthcare, finance, automotive, education, and customer service, transforming how we interact with technology in everyday life

Gemini (Google) answering “What is AI?”

Artificial intelligence (AI) is a branch of computer science that aims to create intelligent agents, which are systems that can reason, learn, and act autonomously. AI encompasses a wide range of techniques and technologies, including machine learning, natural language processing, and computer vision.

Key Concepts in AI:

- Machine Learning: This involves training algorithms on large datasets to make predictions or decisions without being explicitly programmed.

- Natural Language Processing (NLP): This enables computers to understand and process human language, allowing for tasks like language translation and sentiment analysis.

- Computer Vision: This focuses on teaching computers to interpret and understand visual information from the world, such as images and videos.

Applications of AI:

AI is being used in a variety of fields, including:

- Healthcare: AI is used to develop new drugs, analyze medical images, and provide personalized treatment plans.

- Finance: AI is used for fraud detection, algorithmic trading, and customer service chatbots.

- Autonomous Vehicles: AI is used to develop self-driving cars and trucks.

- Entertainment: AI is used to create realistic computer graphics and generate personalized recommendations.

Kerntechnologien

Es gibt viele Möglichkeiten, KI-Technologien darzustellen. Hier ist ein Versuch, sie in vier Schlüsseltechnologien zu untergliedern:

Machine Learning

In großen Datenmengen Muster zu finden und daraus Schlüsse zu ziehen ist der Kern vieler heutiger KI-Systeme. Dazu liefert Machine Learning die statistischen Kernmethoden.

Natural Language Processing

Erst seit kurzem ist künstliche Intelligenz in der Lage, menschliche Sprache zu verstehen und zu sprechen. Dies macht Vieles möglich, gerade im Kundenkontakt.

Bildverarbeitung

KI-gestützte Bildverarbeitung ermöglicht es, in Bildern oder Videos mit hoher Präzision Dinge zu erkennen, Veränderungen zu entdecken oder große Mengen zu zählen.

Robotik

Ein Schlüsselfeld der KI ist die Entwicklung autonomer, ineinandergreifende Systeme, die zum Beispiel selbständig ein Fahrzeug lenken können. Hier sind die Fähigkeiten aber noch begrenzt.

Muster erkennen und verstehen

Machine

Learning (ML)

Im Zentrum vieler KI-Technologien (z.B. NLP, Computer Vision, Robotik) steht das sogenannte maschinelle Lernen, also die Fähigkeit, mithilfe statistischer Datenanalysen Erkenntnisse zu gewinnen und diese auf neue Daten anzuwenden. Oder, wie es Wikipedia formuliert: „Maschinelles Lernen ist ein Forschungsgebiet der künstlichen Intelligenz, das sich mit der Entwicklung statistischer Algorithmen befasst, die aus Daten lernen und auf unbekannte Daten verallgemeinern können und somit Aufgaben ohne explizite Anweisungen ausführen können.“

Hintergrund (Geschichte)

Maschinelles Lernen geht auf die 1950er Jahre zurück, als Forscher Algorithmen entwickelten, die einfache Muster in Daten erkennen konnten. Zu Beginn des 21. Jahrhunderts ermöglichten Big Data, leistungsstarke Computerhardware (insbesondere GPUs) und verbesserte Algorithmen zahlreiche Durchbrüche. Seitdem hat sich ML rasch auf fast alle Anwendungsbereiche ausgeweitet.

Wie es funktioniert

Maschinelle Lernsysteme werden anhand von Datensätzen trainiert. Während des Trainings erstellt der Algorithmus Vorhersagen und vergleicht diese mit anderen Teilen der Daten, beispielsweise mit verwandten Ergebnissen. Dieser Prozess wird viele Male wiederholt und verbessert so nach und nach die Genauigkeit. Das endgültige Modell kann dann Vorhersagen zu neuen, unbekannten Daten derselben Art treffen.

Um beispielsweise ein System zu entwickeln, das Maschinenausfälle vorhersagt, können Betriebsdaten mit bestimmten Ausfällen abgeglichen werden. Wenn der ML-Algorithmus ein Muster erkennt (z. B. höhere Temperaturen, Geräusche oder veränderte Effizienz, die regelmäßig einem bestimmten Ausfall vorausgehen), kann der Algorithmus Wartungsmaßnahmen einleiten, bevor die Maschine tatsächlich ausfällt.

Kernkonzepte

Beim maschinellen Lernen geht es in erster Linie um die Mustererkennung in meist großen Datensätzen. Es gibt drei Hauptarten des maschinellen Lernens: überwachtes Lernen (anhand von gekennzeichneten Beispielen), freies Lernen (Erkennen von Strukturen in nicht gekennzeichneten Daten) und bestärkendes Lernen (durch Trial and Error mittels Feedback).

Modernes ML stützt sich häufig auf künstliche neuronale Netze – mathematische Systeme, die durch die Struktur des menschlichen Gehirns inspiriert sind, um die Leistung durch Lernen aus Erfahrungen zu verbessern.

Was ML kann

Heute kommt maschinelles Lernen unter anderem in Suchmaschinen, Empfehlungssystemen, Sprachassistenten, Betrugserkennung, Bildanalyse und autonomen Robotersystemen zum Einsatz. Es kann Tumore in Scans erkennen, Ausfälle von Anlagen in Fabriken vorhersagen, Sprachen übersetzen und realistische Texte, Bilder und sogar Computercodes generieren. Bei vielen spezifischen Aufgaben übertreffen ML-Systeme den Menschen mittlerweile in puncto Geschwindigkeit und Genauigkeit.

ML ist besonders stark bei Aufgaben, die große Mengen strukturierter oder unstrukturierter Daten umfassen, da es Muster aufdecken kann, die für eine manuelle Analyse zu komplex sind. In der wissenschaftlichen Forschung beschleunigt ML zum Beispiel die Arzneimittelentwicklung und Klimamodellierung. In der Wirtschaft unterstützt es Prognosen, Kundensegmentierung und Prozessoptimierung.

Herausforderungen

Maschinelles Lernen hat wichtige Einschränkungen. Es hängt stark von der Qualität und Quantität der zugrunde liegenden Daten ab, um die relevanten statistischen Muster zu finden. Schlechte Daten führen zu falschen Ergebnissen.

Da maschinelles Lernen – wie alle KI-Systeme – den Kontext auf abstrakter Ebene nicht wirklich versteht, benötigt es während des Trainings und der Überprüfungen klare Vorgaben, oft in Verbindung mit zusätzlichen, von Menschen festgelegten Grenzen.

Dies wird besonders schwierig, wenn das Modell selbst intransparent ist und zu einer „Black Box“ wird, bei der unklar bleibt, welche Muster die Entscheidungen des ML beeinflussen. Daher ist eine sorgfältige Governance unerlässlich, insbesondere in Bereichen mit hoher Tragweite.

Mit KI-Systemen Interagieren

Natural Language Processing (NLP)

Es gibt kaum etwas Faszinierenderes, als sich mit Computern in ganz normaler Sprache zu unterhalten, d.h.Fragen zu stellen und sinnvolle Antworten zu erhalten. Über mehr als ein halbes Jahrhundert wurde es versprochen und erwartet, aber erst vor wenigen Jahren waren die ersten großen Sprachmodelle (LLMs) soweit. Wer ChatGPT, Gemini oder andere Systeme ausprobiert, ist von den Ergebnissen tatsächlich beeindruckt – und immer mehr Unternehmen beginnen, diese Large Language Models (LLMs) für die Unterstützung von Mitarbeitenden und für kundenseitige Anwendungen einzusetzen..

Hintergrund (Geschichte)

Die ersten Ideen zur natürlichen Sprachverarbeitung reichen bis in die 1950er-Jahre zurück, als regelbasierte Systeme zur maschinellen Übersetzung entwickelt wurden. Diese frühen Ansätze basierten auf Wörterbüchern und Grammatikregeln. die linguistische Komplexität überforderte sowohl die Logik als auch die Leistung der damaligen Rechner.

In den letzten Jahrzehnten verlagerte sich der Schwerpunkt hin zu statistischen Methoden, bei denen große Datenmengen genutzt wurden, um Sprachmuster zu modellieren. Der eigentliche Durchbruch gelang in den letzten 10-15 Jahren mit dem Aufkommen von Deep Learning und großen Sprachmodellen, die Spracherkennung (LLMs), Textgenerierung und Übersetzungen erstmals in hoher Qualität ermöglichten.

Wie es funktioniert

Ein NLP-System wandelt Text in eine numerische Repräsentation um. Dabei wird der Text in kleinere Einheiten (z. B. Wörter oder Wortteile) zerlegt und in Form von Vektoren in einem mehrdimensionalen Raum abgebildet. Diese Vektoren erfassen Bedeutungszusammenhänge auf Basis statistischer Muster, dh. wie verschiedene Wörter im Zusammenhang zueinander auftreten.

Im Rahmen des Trainings sagt das Modell fehlende Wörter, nächste Wörter oder Satzstrukturen voraus und passt seine Parameter an, um Fehler zu reduzieren. Daraus lernt es statistische Beziehungen zwischen Wörtern und Sätzen. Diese gelernten Zusammenhänge nutzt das Sprachmodell dann für das Verständnis von Texten und die Generierung von Output. Wie alle Machine-Learning-Systeme arbeitet es mit Wahrscheinlichkeiten – es „versteht“ Sprachinhalt und -kontext nicht im menschlichen Sinne, obschon es uns diesen Eindruck gibt.

Kernkonzepte

NLP verbindet Linguistik mit maschinellem Lernen. Diese Systeme analysieren Grammatik (Syntax), Bedeutung (Semantik) und leiten daraus Absicht bzw. Kontext (Pragmatik) ab.

Heutige Systeme basieren primär auf ML-Architekturen, insbesondere sogenannten Transformern. Diese analysieren Beziehungen zwischen Wörtern innerhalb eines Satzes, anstatt sich auf starre Grammatikregeln zu stützen. Sie lernen dabei, aus sehr großen Textmengen Muster herauszufiltern.

Kleine und große Sprachmodelle werden zunächst auf allgemeine Sprach- und Denkfähigkeiten trainiert. Für spezifische Anwendungen werden sie anschließend feinjustiert. Oft werden Sie durch spezifische Daten ergänzt, die sich je nach Anwendung unterscheiden.

Was NLP kann

NLP-Systeme können übersetzen, Informationen extrahieren und selbst Dialog erzeugen. In vielen Fällen reduzieren sie den manuellen Aufwand bei textintensiven Aufgaben erheblich.

Große Sprachmodelle können Essays schreiben, programmieren, und Dialoge simulieren, und vieles mehr. Vor allem ermöglichen sie die Interaktion von Benutzern in normaler Sprache. In der Forschung hilft NLP, wissenschaftliche Daten und Publikationen in großem Umfang zu analysieren. Auch wenn die Leistungsfähigkeit je nach Aufgabe variiert, hat NLP inzwischen ein Niveau erreicht, auf dem menschenähnliche Sprachinteraktion in realen Anwendungen zunehmend realistisch ist.

Herausforderungen

So „menschlich“ NLP-Systeme auch klingen mögen, sie unterliegen systembedingten Einschränkungen. Sie können ohne Probleme flüssige, aber faktisch falsche oder irreführende Informationen erzeugen. Hinzu kommt, dass sie alle Fehler oder Verzerrungen (Bias) aus den zugrunde liegenden Daten reproduzieren.

Da sie ausschließlich auf de Basis von statistischen Mustern arbeiten und nur ein begrenztes kontextuelles Verständnis besitzen, haben NLMs immer mal wieder Schwierigkeite, logische Konsistenz zu erzeugen. Zudem hängen sie vollständig von den während des Trainings sowie durch Feedback bereitgestellten Informationen ab – was insbesondere bei großen offenen Modellen problematisch sein kann.

Sehr oft wird der Aufwand unterschätzt, den es braucht, um Sprachmodelle für spezifische Anwendungen zu trainieren. Dies erfordert erhebliche Ressourcen und muss sich auch mit Fragen zu Datenschutz, Fehlinformationen und Missbrauch auseinandersetzen. Kontinuierliche Prüfung und Überwachung sind unerlässlich.

Dinge sehen und erkennen

Bildverarbeitung

Obschon die Fähigkeiten unseres menschlichen Gehirns nach wie vor unerreicht sind - wenn es um die Nutzung unserer Augen zur Bewegungskoordination geht, haben uns Computer bei der reinen Bildverarbeitung weit überholt. Dies ist besonders da der Fall, wo es darum geht, Muster und Unregelmäßigkeiten zu finden. Einer der größten Vorteile von Computern ist zudem, dass sie ohne Probleme auch unter Bedingungen arbeiten, die für uns Menschen unzumutbar sind.

Hintergrund (Geschichte)

Die ersten Arbeiten zum Thema Bildverarbeitung begannen in den 1960er und 1970er Jahren mit Programmen zur Erkennung einfacher Formen. Diese frühen Systeme basierten auf manuell festgelegten Regeln und waren aufgrund ihrer Komplexität überfordernd. Eine der ersten Anwendungen war die optische Zeichenerkennung (OCR) zum Scannen von Dokumenten.

In den 2000er Jahren beschleunigte sich der Fortschritt durch verbesserte Hardware, große Datensätze und maschinelles Lernen. Ein wichtiger Durchbruch gelang 2012, als Deep Learning die Erkennungsgenauigkeit erheblich verbesserte. Seitdem hat sich die Bildverarbeitung zu einer Schlüsselanwendung entwickelt.

Kernkonzepte

Im Kern konzentriert sich Bildverarbeitung darauf, aus visuellen Daten, die auf durch numerische Werte dargestellten Pixeln basieren, aussagekräftige Informationen zu extrahieren. Bildverarbeitungssysteme müssen Muster innerhalb dieser Zahlen erkennen, um Objekte, Formen, Texturen und – beim Vergleich mehrerer Bilder – Bewegungen zu identifizieren.

Moderne KI-gestützte Bildverarbeitung (Computer Vision) stützt sich stark auf tiefe neuronale Netze. Anstatt sich auf handgeschriebene Regeln zu verlassen, lernen diese Systeme visuelle Muster direkt aus großen Sammlungen beschrifteter Bilder.

Wie es funktioniert

Ein Computer-Vision-System wandelt Bilder in numerische Daten um, in der Regel auf Pixelebene. Während des Trainings werden dem Modell viele Beispiele für die zu verarbeitenden Daten gezeigt. Es erstellt Vorhersagen, vergleicht diese mit den richtigen Labels und passt interne Parameter an, um Fehler zu reduzieren. In vielen Iterationen lernt es, welche visuellen Merkmale bestimmten Objekten oder Kategorien entsprechen.

Nach dem Training kann das Modell Bilder klassifizieren, Objekte in Bildern erkennen oder Bilder in aussagekräftige Bereiche segmentieren. Bei der Objekterkennung identifiziert das System beispielsweise sowohl die Art eines Objekts als auch dessen Position im Bild. Wie andere maschinelle Lernsysteme „sieht” es nicht im menschlichen Sinne, sondern berechnet Wahrscheinlichkeiten auf der Grundlage gelernter visueller Muster.

KI-Systeme werden zunehmend auch für die Bilderzeugung eingesetzt, also für die Produktion realistischer, aber künstlicher und oft irreführender Darstellungen der Realität.

Herausforderungen

Obwohl ihre Fähigkeiten oft die menschliche Leistung übertreffen, haben Computer-Vision-Systeme ihre Grenzen. Sie haben Schwierigkeiten mit unbekannten Informationen, ungewohnten Bedingungen oder sich überlappenden Objekten. Ebenso können sie zwar selbst kleinste Veränderungen erkennen, aber es fällt ihnen immer noch schwerz, zu erkennen, was relevant ist und was nicht.

Ein weiteres Problem ist die Voreingenommenheit, beispielsweise bei der Gesichtserkennung. Aufgrund einseitiger Trainingsdaten variiert ihre Genauigkeit häufig zwischen verschiedenen ethnischen Gruppen. Und letztendlich „erkennen“ sie keine Objekte, sondern nur statistische Muster. Dies kann zu gefährlichen Fehlern führen. Wie bei allen Tools sind eine sorgfältige Überwachung und Steuerung erforderlich.

Darüber hinaus bringen die Herausforderungen, die sich aus der Bilderzeugung ergeben, völlig neue ethische und regulatorische Probleme mit sich.

Was Bildverarbeitung kann

IN Bewegung kommen

Robotik

Die Entwicklung autonomer Systeme, die physische Handlungen ausführen können, wie beispielsweise das Fahren eines Fahrzeugs auf der Grundlage der Steuerung von Geräten mithilfe von Sensoreingaben und Logik, ist ein Schlüsselbereich der KI, der jedoch nach wie vor sehr schwer zu beherrschen ist.

Hintergrund (Geschichte)

Der Bereich der Robotik konzentriert sich auf die Konstruktion, den Bau und den Betrieb von Maschinen, die physische Aufgaben ausführen können. Nach zahlreichen Experimenten seit Beginn des 18. Jahrhunderts wurden in den 1960er Jahren die ersten Industrieroboter eingeführt, die vor allem für repetitive Aufgaben in der Fertigung wie Schweißen und Montage eingesetzt wurden.

Jahrzehntelang waren Roboter hauptsächlich auf industrielle Umgebungen beschränkt. Fortschritte in den Bereichen Rechenleistung, Sensoren und maschinelles Lernen haben ihren Einsatzbereich erweitert und die Robotik in den Alltag gebracht.

Wie es funktioniert

Ein Roboter arbeitet in einem kontinuierlichen Zyklus aus Erfassen, Planen und Ausführen. Sensoren sammeln Daten über die Umgebung – beispielsweise Entfernung, Position, Temperatur oder visuelle Inhalte. Das Steuerungssystem verarbeitet diese Informationen und legt die geeignete Aktion fest. Der Roboter führt dann die Bewegung oder Aufgabe aus, häufig mithilfe von Motoren oder Aktoren.

Bei einfachen Industrierobotern sind die Bewegungen vorprogrammiert und werden präzise wiederholt. In fortschrittlicheren Systemen ermöglichen maschinelles Lernen und Echtzeit-Feedback den Robotern, sich an veränderte Bedingungen anzupassen. Beispielsweise kann ein Lagerroboter Sensoren einsetzen, um Hindernissen auszuweichen, während er sich zu einem Zielort bewegt.

Kernkonzepte

Im Kern verbindet Robotik Mechanik (wie sich ein Roboter bewegt), Elektronik (wie er angetrieben und gesteuert wird) und Software (wie er Entscheidungen trifft). Ein Roboter besteht in der Regel aus Sensoren zur Wahrnehmung seiner Umgebung, Aktoren (wie Motoren oder Ventile) zum Ausführen von Aktionen und einem Steuerungssystem zur Koordination der Aktionen.

Moderne Robotik integriert häufig Machine Learning-Ansätze, um Wahrnehmung, Planung und Entscheidungsfindung zu ermöglichen. Beispielsweise kann ein Roboter Computer Vision zur Erkennung von Objekten, maschinelles Lernen zur Verbesserung der Leistung im Laufe der Zeit und Bewegungsplanungsalgorithmen zur sicheren Navigation einsetzen. Das Ziel besteht darin, Systeme zu schaffen, die entweder autonom oder unter menschlicher Aufsicht effektiv mit der sich verändernden physischen Welt interagieren können.

Was Robotik kann

Roboter werden häufig für repetitive, gefährliche oder hochpräzise Aufgaben eingesetzt. Zunehmend werden sie auch für spezifische Aufgaben verwendet, die eine hohe Präzision erfordern.

Roboter saugen inzwischen auch Wohnungen, fahren herum und erkunden gefährliche oder weit entfernte Orte.

Herausforderungen

Die Robotik, insbesondere wenn es um Roboter geht, die sich in einem offenen Raum wie einer Straße oder einem Gelände bewegen, ist nach wie vor ein sehr schwieriges Gebiet, das erhebliche Sensorik- und Rechenleistung erfordert. Ein autonomes Auto unter allen Bedingungen wie unter einem menschlichen Fahrer fahren zu lassen, ist nach wie vor eine große und kostspielige Herausforderung. Und die Entwicklung humanoider Roboter, die laufen und ihre „Hände” geschickt einsetzen können, ist noch weit davon entfernt, die Fähigkeiten eines kleinen Kindes zu erreichen, wenn es darum geht, sensorische Eingaben zu verarbeiten und in flüssige und nahtlose Bewegungen umzusetzen.

Roboter erfordern außerdem einen erheblichen technischen Aufwand, Wartungsarbeiten und Sicherheitsvorkehrungen. Die Lebensdauer der Batterien, mechanischer Verschleiß und Systemausfälle können die Leistung beeinträchtigen und ein Risiko für Personen- und Sachschäden darstellen. Darüber hinaus bleiben ethische und wirtschaftliche Fragen – wie zum Beispiel der Verlust von Arbeitsplätzen und die Sicherheit – wichtige Aspekte, die im Zuge der Weiterentwicklung berücksichtigt werden müssen.

Das Verständnis für die verschiedenen Ansätze ist Voraussetzung für die Einführung von erfolgreichen KI-Systemen. In jedem Bereich hat KI klare Vor- und Nachteile, die sorgfältig bedacht und bei der Entscheidung über den Lösungsweg berücksichtigt werden müssen.

Wenn Sie mehr über die Geschichte von Künstlicher Intelligenz und unsere eher philosophische Sicht darauf erfahren möchten, geht es unten weiter. Andernfalls erfahren Sie hier, wie wir Sie bei KI-Themen unterstützen können.

Die Geschichte Künstlicher Intelligenz

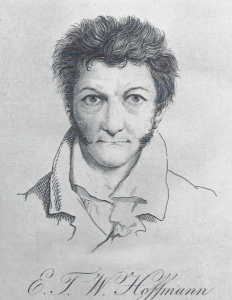

1816: Fiktion

1

Die Idee intelligent handelnder "Automaten" ist viel älter als der Computer selbst. E.T.A. Hoffmann zum Beispiel beschrieb in seiner Kurzgeschichte "Der Sandmann" schon im Jahr 1816 ein schönes Mädchen namens Olimpia, die wunderbar tanzen und singen, aber nur wenige Worte sprechen konnte. Sie ist tatsächlich ein vom Physikprofessor Spalanzani entwickelter Automat gewesen.

Die 40er: Der Turing-Test

Mit den ersten Computern in den 1940er Jahren kam auch schnell die Idee auf, diese könnten schon bald so intelligent sein wie der Mensch. Im Jahr 1949 entwickelte der britische Mathematiker Alan Turing einen Test, um die Fähigkeit eines Computers zu testen auf menschliche Dialogfähigkeiten zu testen. Es dauerte danach noch 65 Jahre, bis ein KI-System seinen Test erstmals knapp bestand.

2

1966: Eliza

3

Als der Psychologe Joseph Weizenbaum im Jahr 1966 sein Chatprogramm "Eliza" entwickelte, verstand er das als spielerischen Versuch, den Dialog mit einem Psychologen in natürlicher Sprache zu simulieren. Obschon das Programm sehr simpel war, hatten viele Leute dennoch den Eindruck von ausgesprochen einzigartiger Intelligenz und sahen dies als Vorboten an, schon bald normal mit Computern sprechen zu können.

Die 80er: Machine Learning

Mit zunehmender Rechenleistung und Speicherkapazität, die große Datenmengen handhaben konnten, wurde Machine Learning realistisch. Damit war es möglich, durch Algorithmen Muster in riesigen Datenmengen zu finden, sie mit bestimmten Ereignissen zu verknüpfen - und daraus Handlungsempfehlungen zu generieren.

4

Die 90er: Schach spielen (und gewinnen)

5

Im Jahr 1997 gewann IBMs Supercomputer Deep Blue erstmals ein ganzes Match gegen den amtierenden Schachweltmeister Garry Kasparov. Hauptsächlich befeuert durch die riesige Rechenleistung, die mehr als 200 Millionen Positionen pro Sekunde prüfen konnte, nutzte das Programm auch KI-nahe Machine Learning-Algorithmen (Heuristik und Minimax Optimierungen).

Die 2000er: Sehen und Wissen

Nachdem optische Zeichenerkennung (OCR) schon länger funktionierte, waren Computern nun plötzlich in der Lage, zu "sehen". Die ersten Gesichts- und Objekterkennungsprogramme tauchten auf. Heute sind KI-Systeme problemlos in der Lage, Objekte und Personen zu erkennen und Bewegungen zu erfassen.

6

Die 2010er: Komplexe Probleme lösen

7

Nachdem es seit den 1970ern um KI eher still geworden war, führten in den 2000ern alle Anstrengungen, Computer "intelligent" zu machen, zu einer Kulmination von neuen Fähigkeiten, die den Begriff "Künstliche Intelligenz" wieder ins Rampenlicht beförderten. Inzwischen waren auch normale Desk- und Laptops leistungsfähig genug, um KI-Aufgaben zu bewältigen.

Die 2020er: Zuhören und Sprechen

Inzwischen erlauben Durchbrüche in konversationeller KI es, dass wir in normaler Sprache mit Computern interagieren. Diese Large Language Models (LLMs) bestehen den Turing-Test routiniert, das heißt sie verstehen und antworten uns in unserer menschlichen Sprache.

8

ChatGPT answering

"What is AI?"

Artificial Intelligence (AI) is the field of computer science focused on creating systems that can perform tasks that normally require human intelligence. AI enables machines to learn from experience, adapt to new inputs, and perform tasks like problem-solving, language understanding, perception, and decision-making.

AI can be broken down into several types and subfields:

- Narrow AI (or Weak AI) – AI systems designed for specific tasks, like voice recognition (e.g., Siri, Alexa), image recognition, or playing a game of chess. They excel at a narrow set of tasks but lack general awareness.

- General AI (or Strong AI) – Hypothetical AI that could perform any intellectual task a human can do, with the ability to reason, plan, and understand complex concepts. This level of AI does not yet exist.

- Machine Learning – A subset of AI that uses algorithms and statistical models to allow computers to learn from and make decisions based on data. For instance, machine learning is used in recommendation systems and predictive analytics.

- Deep Learning – A further subset of machine learning that uses artificial neural networks, inspired by the human brain, to analyze data and make decisions. Deep learning is commonly used in advanced image recognition, language processing, and autonomous driving.

- Natural Language Processing (NLP) – The branch of AI that focuses on enabling machines to understand, interpret, and respond to human language in a meaningful way.

AI is increasingly used in fields like healthcare, finance, automotive, education, and customer service, transforming how we interact with technology in everyday life.

Gemini answering

"What is AI?"

Artificial intelligence (AI) is a branch of computer science that aims to create intelligent agents, which are systems that can reason, learn, and act autonomously. AI encompasses a wide range of techniques and technologies, including machine learning, natural language processing, and computer vision.

Key Concepts in AI:

- Machine Learning: This involves training algorithms on large datasets to make predictions or decisions without being explicitly programmed.

- Natural Language Processing (NLP): This enables computers to understand and process human language, allowing for tasks like language translation and sentiment analysis.

- Computer Vision: This focuses on teaching computers to interpret and understand visual information from the world, such as images and videos.

Applications of AI:

AI is being used in a variety of fields, including:

- Healthcare: AI is used to develop new drugs, analyze medical images, and provide personalized treatment plans.

- Finance: AI is used for fraud detection, algorithmic trading, and customer service chatbots.

- Autonomous Vehicles: AI is used to develop self-driving cars and trucks.

- Entertainment: AI is used to create realistic computer graphics and generate personalized recommendations.